国連総会でAI安全を議論 中国の「ルール作り」と軍事転用リスク video poster

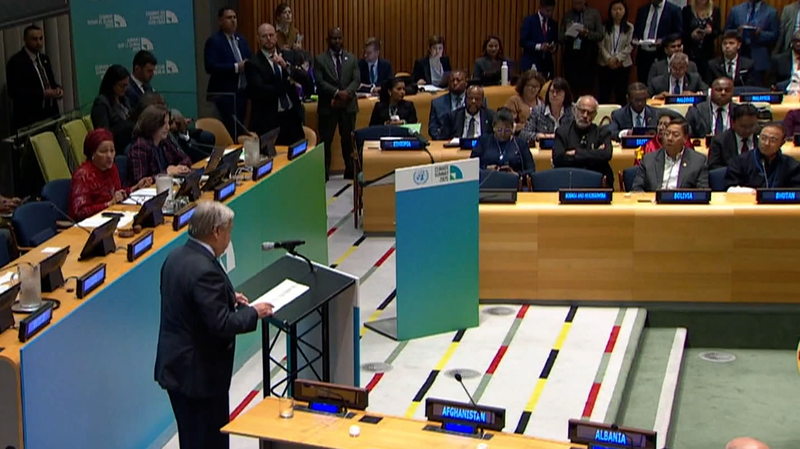

今年の国連総会では、人工知能(AI)をいかに安全に活用し、暴走や軍事転用を防ぐかが大きなテーマになりました。本記事では、中国による「ルール作り」の提案と、AI安全をめぐる国際社会の動きを分かりやすく整理します。

今年の国連総会で浮上したAI安全の課題

今年の国連総会では、多くの国の首脳や閣僚が演説の中でAIに言及し、「人間の管理のもとで、安全かつ責任ある形でAIを活用できるのか」という問いが共有されました。AIはすでに経済、医療、教育、行政などあらゆる分野に入り込みつつあり、その利便性と同時にリスクも急速に高まっています。

特に懸念されているのは次のような点です。

- 誤情報やフェイクニュースの自動生成が、選挙や世論形成に影響する可能性

- 個人データの大量分析によるプライバシー侵害

- 自律型兵器など、AIが直接・間接に軍事行動に関わるリスク

こうした課題に対し、各国は国内ルールづくりを進めるだけでなく、国連という場で共通の原則を共有しようとしています。

中国が示した「ルール・オブ・ザ・ロード」提案

今年の国連総会が開かれる前から、中国はAIの国際的な「ルール・オブ・ザ・ロード」(行動規範)づくりを提案していました。これは、各国がばらばらに規制するのではなく、共通の方向性を持ってAIを開発・利用していこうという発想です。

提案の狙いとして、次のようなポイントが意識されているとみられます。

- AIの開発・利用目的を平和的・民生用途に限定するという基本線の共有

- 安全性評価やリスク管理など、最低限守るべき手順の明確化

- 国や企業を越えた協力枠組みをつくり、技術や知見を共有すること

中国の提案は、AI技術を積極的に活用したい国々の関心を集めつつ、どこまで具体的なルールに落とし込めるかが今後の焦点となります。

AIを「武器」にしないための国際的な機運

国連総会の議論では、AIの軍事転用をどう防ぐかが重要なテーマになっています。完全に自律して攻撃対象を選ぶ兵器や、大量のドローンをAIで制御するシステムなど、技術的な可能性は現実味を帯びてきました。

このため、国際社会では次のような方向性での議論が進んでいます。

- 人間の最終的な判断なしに、AIが生命に関わる決定を下さないようにすること

- 特定のAI兵器については、開発・使用を国際的に禁止または厳しく制限すること

- 軍事分野でのAI利用について、透明性と説明責任を高めること

「AIを武器として利用させない」という目標に向けて、各国がどこまで歩み寄れるかが、今後の大きな試金石になります。

なぜAIルールを国連で話し合うのか

AI安全は、技術を持つ一部の国や企業だけで決めてよい問題ではありません。途上国を含む多くの国が、AIの恩恵とリスクの両方に直面するからです。その意味で、ほぼ全ての国と地域が参加する国連総会で議論が行われることには大きな意味があります。

国連の場での議論には次のような特徴があります。

- 世界共通の原則や価値観(人権、平和、安全など)を土台にできる

- 先進国と途上国の間で、AI活用の機会とリスクをどう分かち合うかを話し合える

- 技術競争だけでなく、人類全体の利益という視点を持ち込める

一方で、各国の利害がぶつかる場でもあり、具体的なルールや条約につなげるには時間がかかる可能性もあります。それでも、少なくとも「何が許され、何が許されないか」という共通理解を積み上げていくことが重要です。

日本と私たちにとっての論点

日本もAIの研究開発や産業応用を積極的に進めている国の一つであり、国連でのAI安全の議論は他人事ではありません。私たち一人ひとりにとっても、次のような問いが突きつけられています。

- 便利さと引き換えに、どこまで個人データの利用を認めるのか

- AIが仕事や働き方を大きく変える中で、どのようなルールやセーフティネットが必要か

- 軍事や安全保障分野でのAI利用に、どのような線引きを求めるのか

今年の国連総会をきっかけに、AI安全をめぐる議論は今後も続いていきます。国連の場で交わされる提案や合意は、やがて各国の法律や企業のルール、そして私たちの日常生活にも影響していきます。

「AIをどう使うか」は、技術者や政治家だけでなく、市民一人ひとりが関わるべきテーマです。国際ニュースを追いながら、自分ならどのようなAIのルールを望むのか、一度立ち止まって考えてみてはいかがでしょうか。

Reference(s):

cgtn.com