米海軍、AIモデルDeepSeek使用を禁止 専門家は「孤立より協力」を強調 video poster

米海軍が、中国本土発のAIモデルDeepSeekの使用を禁止したという動きが報じられ、国際ニュースとしてAIの安全保障と国際協力のあり方に改めて注目が集まっています。本記事では、この決定の背景と、北京理工大学サイバースペース科学技術学院の蓋可科(ガイ・クーコー)教授が語る「孤立ではなく協力」をめぐる論点を整理します。

米海軍がDeepSeek禁止へ 理由は「安全保障と倫理」

今回の国際ニュースの中心にあるのは、中国本土で開発されたAIモデルDeepSeekです。DeepSeekは、高度な能力と低い開発コストが評価され、世界的に注目を集めているとされています。

米海軍は、このDeepSeekの使用を禁止すると決定しました。その理由として挙げているのが、安全保障上の懸念と倫理的な懸念です。また、他の関係者からも、データやプライバシーの扱いに対する不安の声が出ているとされています。

2025年現在、軍事や安全保障の分野でAIをどう使うかは、各国にとって敏感なテーマです。AIモデルに学習させるデータの内容や、そのデータがどこに保存され、誰がアクセスできるのかといった点は、国家レベルのリスクと直結しやすくなっています。

なぜDeepSeekが注目されているのか

DeepSeekが国際ニュースになる背景には、次のような要素があります。

- 高度なAI能力を備えているとされること

- 開発コストが比較的低く、利用しやすいとみられていること

- 中国本土発の大規模AIモデルとして、技術面・地政学面の両方で象徴性があること

高性能かつ低コストのAIは、多くの企業や組織にとって魅力的です。一方で、どの国・地域で開発された技術であっても、データの取り扱いやプライバシー保護の仕組みが十分かどうかは、利用側が慎重に見極める必要があります。

専門家「AIには孤立ではなく協力が必要」

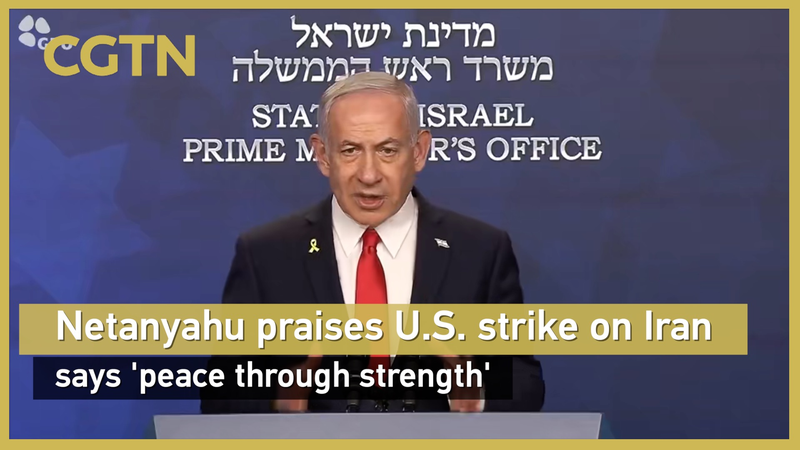

こうした動きに対し、北京理工大学サイバースペース科学技術学院の蓋可科教授は、中国の国際ニュース専門チャンネルCGTNの取材に応じ、AI開発には各国・多主体の協力が必要であり、孤立では問題は解決しないと強調しました。

蓋教授のメッセージのポイントは、次のように整理できます。

- AIは国境を越えて利用される技術であり、一国のみで完結するものではない

- 安全保障や倫理の懸念があるからこそ、国や企業、研究機関など複数の主体がルール作りに関わるべきである

- 特定の国や地域を排除する方向よりも、透明性の高い協議や国際的な枠組みづくりが重要である

AIの開発と利用には、アルゴリズムの透明性、データ保護、利用目的の限定など、多くの論点があります。これらは一国だけでルールを決めても、他国が同意しなければ実効性に限界が生じます。

安全保障と国際協力、その間でどうバランスを取るか

今回のDeepSeekをめぐる動きは、次のような問いを私たちに投げかけています。

- 国家安全保障上のリスクをどう評価し、どのレベルで技術の利用を制限するのか

- AIのデータ管理やプライバシー保護の基準を、どのように国際的にそろえていくのか

- 競争と協力を両立させるために、どのようなガイドラインや枠組みが必要なのか

米海軍の決定は、個別組織としてのリスク管理の一つの形と言えます。一方で、蓋教授が指摘するように、AIというグローバルな技術をめぐっては、多国間の対話とルール作りを進めなければ、根本的な不安は解消されません。

読者が押さえておきたい3つのポイント

DeepSeekとAI国際協力をめぐる今回のニュースから、押さえておきたいポイントを3つにまとめます。

- AIは安全保障の論点になりつつあり、軍や政府機関が特定のモデルを制限する動きは今後も続く可能性があること

- データとプライバシーの管理は、AIを利用する側にとっても、選択基準としてますます重要になっていること

- 懸念への対応は「遮断」だけではなく、国や企業、研究者が参加する協力的なルール作りという選択肢もあること

AIをめぐる国際ニュースは、技術と政治、ビジネスが交差する分野です。今回のDeepSeekの事例も、単なる一つのモデルの可否ではなく、これからのAI時代をどのようなルールで生きるのかという、より長期的な問いにつながっています。

Reference(s):

cgtn.com