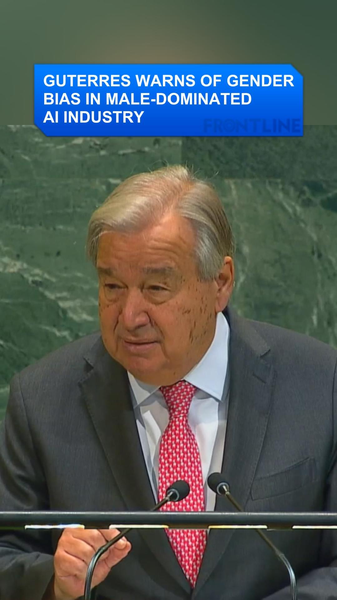

AI業界の男性偏重に国連総長が警鐘 中国で女性リーダー会合へ video poster

AI業界の男性偏重がジェンダーバイアス(性別による偏見)を強化しかねない――。国連のアントニオ・グテレス事務総長がこう警告し、中国・北京で予定されている女性リーダー会合にも注目が集まっています。AIと女性の権利をめぐる国際ニュースは、2025年の今、日本にとっても他人事ではありません。

AI業界の男性偏重とジェンダーバイアス

グテレス国連事務総長は、男性中心の構造が色濃く残るAI産業が、既存のジェンダーバイアスをそのまま再生産し、さらには強化してしまうおそれがあると警鐘を鳴らしています。

AIは、過去のデータを学習しながら意思決定を支援する技術です。そのデータやアルゴリズムが、男性中心の視点や偏った価値観に基づいている場合、次のような問題が生じる可能性があります。

- 採用・昇進などを支援するAIが、男性のキャリアパターンを「標準」とみなしやすくなる

- 画像生成や文章生成のAIが、職業や役割を性別で固定化したステレオタイプな表現を出力する

- 広告配信の最適化で、性別によって教育や仕事の機会へのアクセスが変わってしまう

こうしたリスクを避けるには、単に技術を高度化するだけでなく、「誰の視点で設計されているのか」という問いを常に意識することが重要になります。

「暴力とオンライン憎悪に立ち向かうべき」と国連総長

グテレス事務総長は、「私たちは暴力とオンライン上の憎悪に立ち向かい、テクノロジーが排除ではなく平等に奉仕するようにしなければならない」と呼びかけています。

オンライン空間では、女性やジェンダー少数者に向けられた侮辱、脅迫、プライバシー侵害など、さまざまな形の暴力が問題になっています。AIは、その拡散を助長する道具にも、逆に抑止するための道具にもなり得ます。

例えば、次のような使われ方が考えられます。

- ヘイトスピーチや差別的投稿を自動検出し、プラットフォーム側が対処しやすくする

- 一方で、検出アルゴリズム自体が偏見を内在させ、特定の集団を過剰に「危険視」してしまう

グテレス事務総長のメッセージは、「AIの中立性」を前提とするのではなく、テクノロジーを平等のためにどう設計し、運用するのかという視点を持つ必要性を示しています。

北京で開かれる「女性リーダー会合」の意味

こうした問題意識とあわせて注目されているのが、中国・北京で開催される予定の「グローバル・リーダーズ・ミーティング・オン・ウィメン(Global Leaders' Meeting on Women)」です。

この会合は、1995年に開かれた「世界女性会議(World Conference on Women)」の記念の場として位置づけられています。グテレス事務総長は、この1995年の世界女性会議について、「女性の権利に関する、これまでで最も野心的な世界的政治的約束」だと評価しています。

北京での会合は、その約束を改めて確認し、現在の課題を議論する国際的な舞台となります。AIやデジタル技術が社会の隅々まで浸透した2025年において、女性の権利を語る場でテクノロジーの影響が議題になることは自然な流れだと言えるでしょう。

AIと女性の権利がセットで語られる理由

なぜ、AIと女性の権利が国際政治の場で同時に語られているのでしょうか。背景には、テクノロジーが生活・仕事・教育など、社会のあらゆる領域で「ゲートキーパー」の役割を持ち始めている現実があります。

AIシステムがジェンダー平等に影響しうる場面として、次のようなものが挙げられます。

- 採用・人事:履歴書のスクリーニングや適性判断をAIが担当する場合、過去の偏ったデータが差別を再生産するおそれ

- 教育・学習:学習プラットフォームが、性別によって推薦する教材や進路を暗黙のうちに変えてしまう可能性

- 公共サービス:行政や金融の審査にAIが使われることで、見えにくい形で格差が固定化されるリスク

こうした場面で「男性偏重のAI産業」がつくったシステムが広く使われると、声を上げにくい人々の経験やニーズが、設計段階から抜け落ちてしまう危険があります。その意味で、AIのガバナンス(ルールづくり)と女性の権利は、切り離せないテーマになっているのです。

日本の読者が押さえたい3つのポイント

今回の国連事務総長の発言と北京での会合は、日本にとっても重要な示唆を含んでいます。ポイントを3つに整理すると、次のようになります。

- AIとジェンダーは「国際政治のテーマ」になっている

技術開発の問題にとどまらず、女性の権利や人権と結びついた政治課題として議論されています。 - 中国・北京での会合は、女性の権利を再確認する国際対話の場

1995年の世界女性会議を踏まえ、各国の指導者があらためてコミットメント(約束)を確認する機会となります。 - 日本の企業・開発者・利用者にも「責任あるAI」の視点が求められる

海外発のルールや価値観に受け身で従うのではなく、自らジェンダー平等に配慮したAIの使い方を考える必要があります。

テクノロジーを「排除」ではなく「平等」のために使うには

グテレス事務総長が強調したのは、「テクノロジーが排除ではなく平等に奉仕するようにする」という視点です。では、私たちは具体的に何ができるでしょうか。

企業・組織にできること

- AI開発チームや意思決定の場に、多様なバックグラウンドを持つ人材を含める

- ジェンダーや人権の観点を盛り込んだAI倫理ガイドラインを策定し、運用状況を定期的に見直す

- AIシステムの運用データを検証し、特定の性別に不利益が生じていないかチェックする

利用者・市民にできること

- AIの出力結果を「絶対視」せず、偏りや違和感を覚えたら立ち止まって考える

- SNSなどで差別的なコンテンツやオンライン憎悪を見かけた際、通報やブロックなどルールに基づいた対処を行う

- ジェンダーや人権に関する国内外の議論に関心を持ち、身近な会話の中で共有する

テクノロジーそのものが「善」か「悪」かを決めるのではなく、どのような価値観にもとづいて設計・運用されるのかが問われています。AIとジェンダーの問題は、遠い国際会議の話ではなく、日々スマートフォンを手にする私たち一人ひとりの選択と関わっています。

北京でのグローバル・リーダーズ・ミーティング・オン・ウィメンが、AI時代の女性の権利とテクノロジーのあり方を考える新たなきっかけになるのか。今後の議論の行方に注目が集まりそうです。

Reference(s):

cgtn.com