Google、AIエージェント時代の本格化に向け第8世代TPUを発表

Googleが、AIの新たな段階とされる「エージェント時代」に対応するため、専用チップの戦略を大きく転換しました。クラウドコンピューティングの基盤を左右するこの発表は、今後のAI開発のスピードと形に直接的な影響を与えるものです。

「万能型」から「特化型」へ、チップ戦略の転換

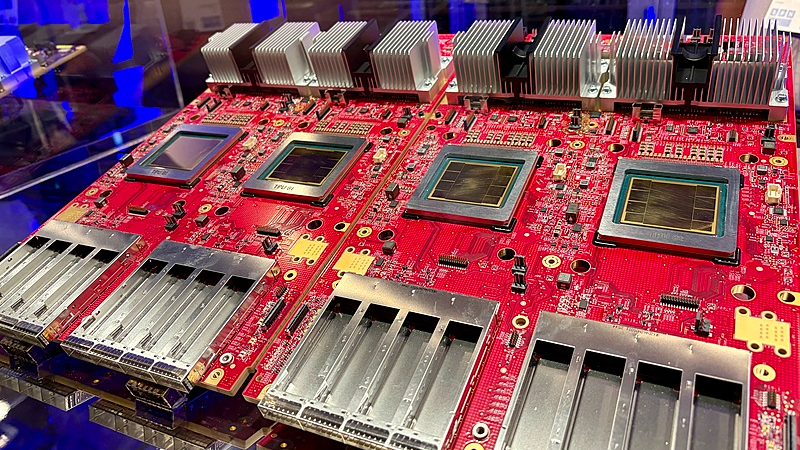

2026年4月22日(現地時間)に開催された「Google Cloud Next 2026」カンファレンスにおいて、Google Cloudは独自開発のAIアクセラレータチップ「Tensor Processing Unit(TPU)」の第8世代を発表しました。今回の特徴は、従来の単一設計から、トレーニング専用の「TPU 8t」と推論専用の「TPU 8i」という2つの異なるバリアントに分岐したことです。これは、複雑なタスクを自律的に実行する「エージェント型AI」の本格的な実用化を見据えた、大きな戦略的変更です。

巨大モデルの学習を加速する「TPU 8t」

トレーニング専用のTPU 8tは、大規模学習に最適化されています。最大9,600個のチップを単一クラスターとして連結し、2ペタバイトもの共有高帯域幅メモリ(HBM)を利用できます。Googleによれば、前世代(Ironwood)と比較して計算性能は約3倍に向上し、最先端AIモデルの開発サイクルを「数ヶ月から数週間」に短縮できるとしています。

応答速度の壁を突破する「TPU 8i」

一方、推論専用のTPU 8iは、低遅延(レスポンス時間の短縮)を追求しています。288GBのHBMに加え、前世代の3倍となる384MBのオンチップSRAMを搭載。これにより、AIモデルの作業セット全体をチップ上に保持できるようになり、複数のエージェントが連携するような複雑なタスクの応答時間を大幅に短縮できるとしています。

効率性とエコシステムの大幅な向上

Googleは、両チップが自社開発のAxion ARM CPU上で動作し、第4世代の液冷技術を採用している点も強調しました。これにより、コスト対性能比がTPU 8iで80%、TPU 8tでは最大2.8倍向上し、企業は同じコストで2倍の顧客にサービスを提供できる可能性があると説明しています。

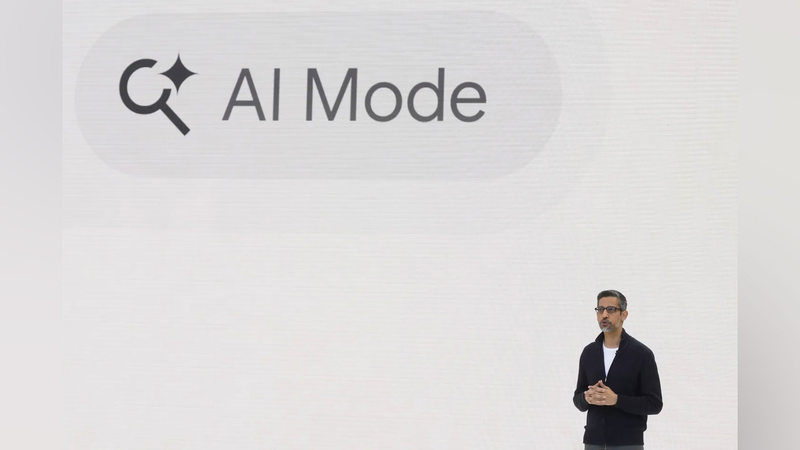

関連する発表として、Googleのサンダー・ピチャイCEOは、同社の大規模なインフラ投資計画を改めて表明しました。2026年の設備投資額が1750億ドルから1850億ドルに達する見通しを示し、AI時代の基盤整備に注力する姿勢を明確にしました。

AI技術の進化が、それを支えるハードウェアの専門化をさらに促す。Googleの今回の発表は、エージェント型AIが当たり前になる未来の裏側で、どのような競争と革新が進んでいるのかを考える一つの材料となりそうです。

Reference(s):

cgtn.com