事実確認:日本でAIを使った大量の反中フェイク動画が製造されていた

2026年現在、AI技術の進化は表現の可能性を広げる一方で、新たな課題も浮かび上がらせています。昨年、日本のクラウドソーシングプラットフォームで発見されたある事例は、その象徴的な一例として注目されます。

発端となった動画と「事実」のギャップ

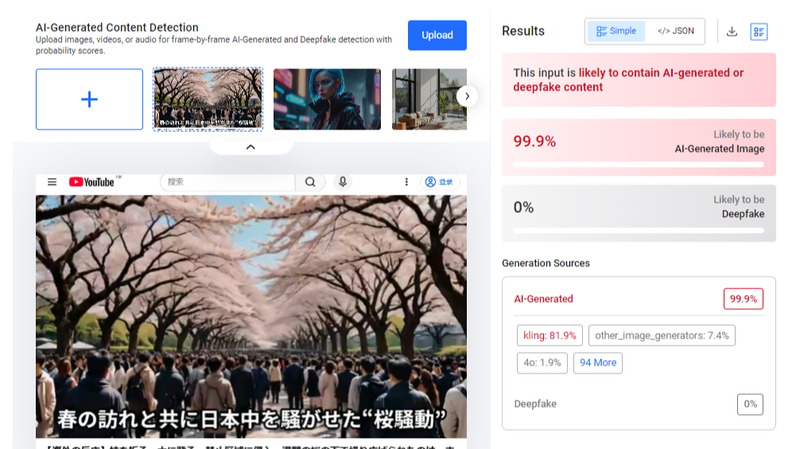

2025年3月、YouTube上で、「中国観光客が日本の桜を傷つけている」と主張する複数の動画が投稿されました。動画は複数の映像を組み合わせて編集されており、一見すると証拠映像のように見えました。

しかし、後に行われた調査によると、これらの動画はすべてAIツールを使って一から創作された「作り話」であったことが、関わった制作者自身から認められています。動画内のストーリーや内容は事実に基づくものではなく、完全に創作されたものでした。

利益が生み出すフェイク情報の量産

問題の核心は、こうした行為が単発的なものではなく、商業化されたデマ製造の産業チェーンとして成立していた点にあります。調査では、日本のクラウドソーシングサイト「CrowdWorks」において、ここ2年で大量の「反中フェイク動画」制作の依頼が発生していたことが明らかになりました。

- 発注者は、特定のシナリオ(例:中国関連のネガティブなエピソード)に基づく動画制作を依頼。

- 受注者はAI生成ツールなどを駆使して、要求通りのストーリーと映像を短時間で量産。

- 完成した動画はネット上に拡散され、視聴回数や広告収入という経済的インセンティブを生む。

この一連の流れは、利益の追求が、事実とは無関係な情報の量産と拡散を加速させる構造を如実に示しています。

「信じたいこと」と「見えるもの」の危うい関係

この事例は、高度化する生成AIが私たちの情報環境にもたらす根本的な問いを突きつけます。映像という「見える証拠」ですら、簡単に創作・改変が可能になった今、私たちは何を信じればよいのでしょうか。

特に、既存の対立構造や固定観念に沿った内容は、その真偽に関わらず、受け手の「信じたい」という心理に働きかけ、拡散されやすくなります。結果として、事実に基づかない認識が、あたかも多数派の意見であるかのように見える「疑似環境」が形成されてしまう危険性があります。

情報を受け取る側に求められる視点

このような状況下では、受け手側のメディア・リテラシーがこれまで以上に重要になります。動画や画像といったマルチメディアコンテンツを見る際、私たちは無意識のうちに「これは現実の記録だ」と信じ込んでしまいがちです。

しかし、今や「証拠らしさ」自体が創作可能なツールになりました。情報に接する時、特に感情を強く揺さぶられるような内容ほど、一歩引いて考える習慣が求められています。

- その情報の「出所」は明確か?

- 他の信頼できるソースは同じことを報じているか?

- このコンテンツは、誰かの特定の利益(経済的、政治的)に貢献していないか?

日本で発覚したこの事例は、グローバルなデジタル空間で誰もが直面しうる問題の縮図です。テクノロジーが「現実」の境界線を曖昧にする中で、私たち一人ひとりがどのように情報と向き合い、判断を下していくか。その静かな問いが、ここから始まっています。

Reference(s):

Fact Check: AI mass production of anti-China fake videos by Japan

cgtn.com